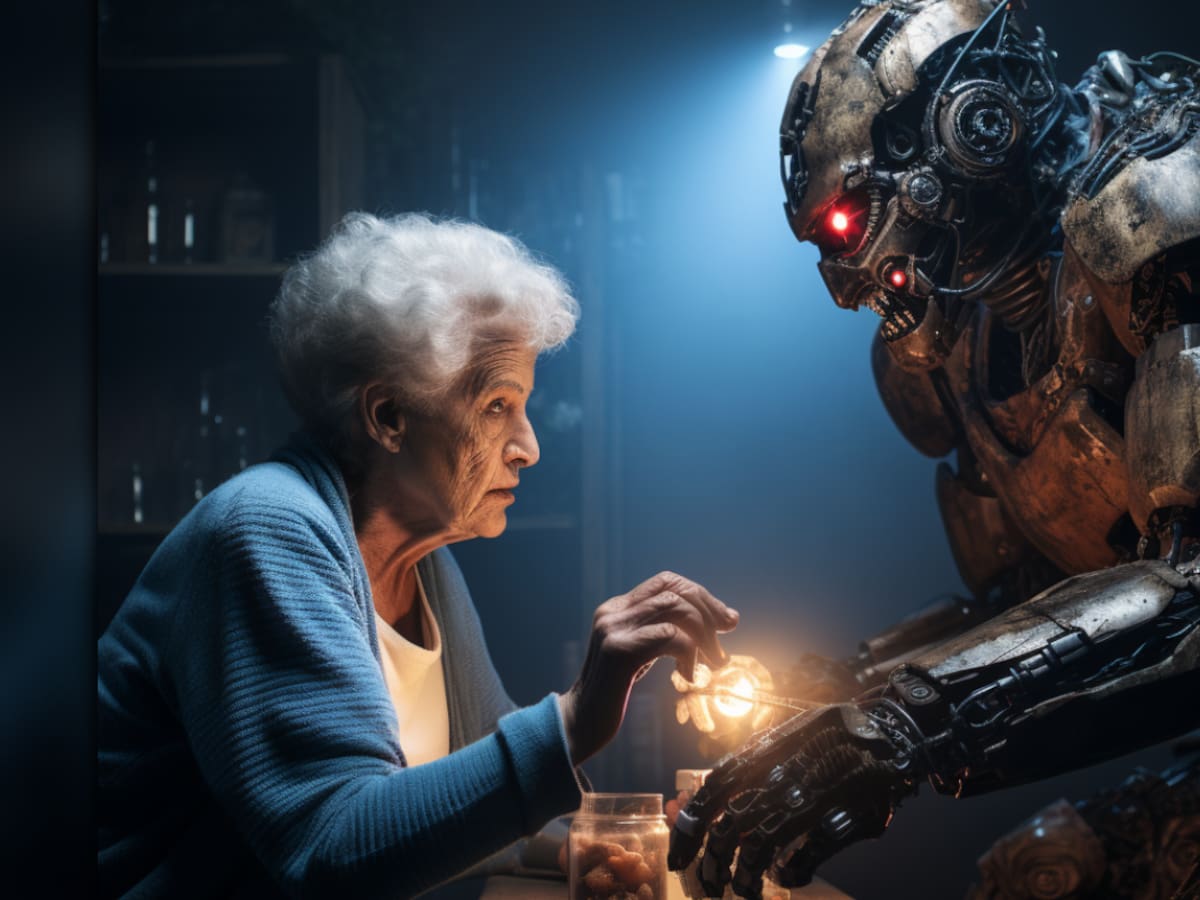

Este tipo de estafas son cada vez más frecuentes ante el avance y facilidad de estas herramientas generadoras de contenido, por lo que te damos los mejores consejos para salvaguardar a los tuyos

La inteligencia artificial avanza cada día a pasos agigantados, por lo que esta tecnología se ha convertido en la nueva herramienta de miles de profesionales y empresas alrededor del mundo, sin embargo, los ciberdelincuentes también han aprovechado su uso para cometer delitos, entre ellos, la suplantación de identidad.

Por medio de inteligencias artificiales capaces de imitar la voz de cualquier persona, muchos criminales llevan a cabo actos de extorsión sobre víctimas que al escuchar la voz clonada de un familiar o conocido, entran en pánico y ceden ante las demandas monetarias de estos malhechores.

Por ello, hoy te traemos los mejores consejos que puedes aplicar para que tus familiares, en específico adultos mayores de edad, sean capaz de defenderse e identificar los intentos de extorsión que utilizan la IA generativa.

Te puede interesar: Ya puedes crear imágenes con inteligencia artificial en el buscador de Google

Cómo proteger a familiares y amigos de estafas con inteligencia artificial

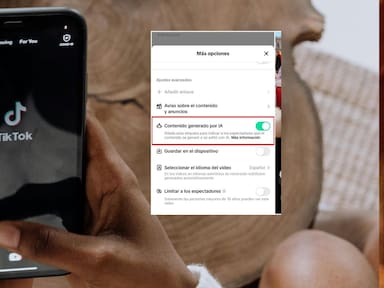

Los estafadores suelen usar estas técnicas de suplantación de identidad y clonación de voz para hacerse pasar por personas conocidas o instituciones y pedir dinero o información personal a sus víctimas, siendo los adultos mayores y las personas vulnerables a la tecnología los más afectados por este tipo de fraudes. ¿Cómo pueden protegerse de estos ataques? Aquí te ofrecemos algunos consejos:

Si crees que has sido víctima de una estafa, denúncialo ante las autoridades competentes y alerta a tus contactos para evitar que caigan en la misma trampa.

Te puede interesar: CEO despidió a su equipo de atención al cliente por "ineficiente" y los reemplazó con ChatGPT